Ce que nous vivons aujourd’hui dépasse une simple euphorie technologique ou la crainte d’une disruption sectorielle. Le cycle de l’IA révèle un paradoxe : à mesure que l’intelligence se dématérialise, les marchés redécouvrent la valeur du tangible.

Nous assistons à une double commoditisation.

Par commoditisation, nous entendons un processus par lequel un produit ou un service, initialement différencié et porteur d’une forte valeur ajoutée, devient progressivement interchangeable. La rareté technologique s’efface, la différenciation s’amenuise, les barrières à l’entrée se réduisent et, in fine, le pouvoir de fixation des prix s’érode. Ce qui était premium devient standard ; ce qui était stratégique devient accessible.

Historiquement, la commoditisation frappe les industries lorsque l’innovation se diffuse plus vite que la capacité à préserver l’avantage compétitif. Le matériel informatique en a fait l’expérience, puis le cloud, puis certaines couches du logiciel. Aujourd’hui, ce phénomène touche simultanément deux niveaux de l’Intelligence Artificielle.

D’une part, l’IA menace le modèle SaaS traditionnel.

Le modèle SaaS — Software as a Service — repose sur un principe simple : le logiciel n’est plus vendu sous forme de licence perpétuelle installée localement, mais proposé via le cloud, accessible par abonnement. L’entreprise paie un montant récurrent, le plus souvent mensuel ou annuel, en fonction du nombre d’utilisateurs (per seat) ou du niveau de service souscrit.

Ce modèle a profondément transformé l’économie du logiciel au cours des deux dernières décennies. Il a offert aux éditeurs une visibilité exceptionnelle sur leurs revenus grâce à la récurrence des abonnements. Il a réduit la cyclicité des ventes, amélioré la prévisibilité des flux de trésorerie et permis des marges élevées une fois les coûts fixes absorbés. Pour les investisseurs, le SaaS est devenu synonyme de croissance durable, de forte rétention client et de cash-flows lointains valorisés à des multiples importants.

Mais ce modèle repose sur trois hypothèses implicites : un logiciel suffisamment complexe pour justifier un abonnement continu, un usage par utilisateur humain, et un coût de remplacement élevé. L’IA générative remet en cause ces piliers. Si un outil peut être recréé en interne via des modèles, la dépendance à l’éditeur diminue. Si des agents automatisent les tâches cognitives, le nombre de licences nécessaires baisse. Et si la différenciation fonctionnelle s’érode, la capacité à maintenir des prix élevés s’affaiblit.

La menace porte donc moins sur des produits que sur la structure même du modèle : la monétisation récurrente par utilisateur dans un monde où le code devient abondant. Les outils génératifs permettent déjà de recréer une part significative de logiciels fonctionnels, notamment pour le segment small et mid business. Le modèle per seat, pilier des marges élevées des vingt dernières années, est sous pression. C’est la première commoditisation.

D’autre part, l’open-source et la distillation accélèrent la convergence des modèles. Si 70 à 80 % des usages peuvent être couverts localement, la dépendance aux API centralisées et aux hyperscalers pourrait être moins structurelle qu’anticipé. C’est la deuxième commoditisation. On y reviendra en seconde partie de ce papier.

Par open-source, nous désignons des modèles d’intelligence artificielle dont l’architecture et les poids sont rendus accessibles — totalement ou partiellement — à la communauté. Cela permet à des entreprises, des développeurs ou des États d’exécuter ces modèles en local, de les modifier, de les optimiser et de les adapter à leurs propres données. Contrairement aux modèles fermés proposés via API par des acteurs comme OpenAI ou Anthropic, l’open-source réduit la dépendance à un fournisseur unique et au cloud centralisé.

La distillation, quant à elle, est une technique d’entraînement consistant à utiliser les sorties d’un modèle très performant — souvent coûteux à entraîner — pour former un modèle plus petit, plus léger et moins onéreux à exploiter. Le modèle distillé n’égale pas nécessairement le modèle d’origine sur tous les plans, mais il peut reproduire une grande partie de ses capacités pour des usages standards. Cette technique accélère la diffusion des performances et réduit l’écart entre modèles de pointe (frontier) et alternatives plus accessibles.

La convergence des modèles signifie donc que l’avantage technologique se compresse plus vite que prévu. Si, pour une PME, un modèle open-source exécuté localement suffit à traiter la majorité des tâches — génération de rapports, analyse documentaire, automatisation administrative — alors la nécessité de recourir en permanence à des API facturées au token diminue. La dépendance aux hyperscalers, c’est-à-dire aux grandes plateformes cloud qui concentrent l’infrastructure de calcul, devient moins structurelle.

C’est en cela que réside la deuxième commoditisation : l’intelligence artificielle elle-même, censée être rare et coûteuse, tend à devenir partiellement interchangeable. Lorsque la performance “suffisamment bonne” devient largement accessible, la rareté technologique s’efface et la capacité à maintenir des marges élevées s’érode. Nous approfondirons cette dynamique dans la seconde partie de ce papier.

Explorons en détail la première commoditisation, avec un exemple concret :

La version entreprise d’Anthropic, via son modèle Claude, permet déjà de générer en quelques heures un logiciel de gestion interne pour une petite entreprise : facturation, suivi client, gestion de stock, tableau de bord financier, automatisation des emails, reporting.

Anthropic est une société américaine spécialisée dans le développement de modèles de langage avancés. Son produit phare, Claude, est un modèle dit “LLM” (Large Language Model), capable de comprendre des instructions complexes, de générer du code, d’analyser des documents volumineux et d’interagir avec des bases de données. Contrairement à une simple interface conversationnelle, la version entreprise de Claude est conçue pour être intégrée aux systèmes internes d’une organisation.

Cela signifie que l’utilisateur peut décrire en langage naturel son besoin : “Je veux un système de gestion pour ma clinique avec facturation, suivi patient et reporting mensuel.” Le modèle génère alors la structure de la base de données, propose une interface utilisateur, crée les fonctions backend nécessaires, configure des automatisations et peut même assister au déploiement sur un environnement cloud ou local.

La différence majeure avec le développement traditionnel tient au fait que l’utilisateur n’a plus besoin de maîtriser les langages de programmation ou l’architecture logicielle. Le modèle agit comme un développeur polyvalent capable d’écrire le code, de l’expliquer et de le corriger en temps réel. Le cycle de production logicielle — autrefois long et coûteux — se trouve compressé de manière spectaculaire.

C’est précisément cette capacité qui fragilise le segment small business. Lorsque la création d’un outil métier devient une fonction conversationnelle, la rareté du développement sur mesure disparaît. La valeur ne réside plus dans l’écriture du code, mais dans l’orchestration, la donnée et la gouvernance du système ainsi créé.

Sur le segment small business, cela change radicalement l’économie du logiciel.

Les agences de développement — historiquement chargées de créer des solutions sur mesure pour des cliniques, restaurants, PME locales ou cabinets professionnels — voient leur proposition de valeur compressée. Leur avantage reposait sur la rareté du code et la complexité technique. Cette rareté disparaît. Une part significative de leur activité, centrée sur des applications CRUD, des back-offices simples ou des CRM légers, devient reproductible à coût marginal quasi nul.

Par CRUD, on désigne un type d’application très courant dans le développement logiciel. L’acronyme signifie Create, Read, Update, Delete — créer, lire, modifier, supprimer. Il s’agit du socle de la plupart des outils métiers : gérer des fiches clients, enregistrer des commandes, modifier des stocks, supprimer des entrées obsolètes. Une application CRUD repose généralement sur une base de données, une interface simple et quelques règles de gestion. C’est le cœur technique de nombreux back-offices pour PME.

Historiquement, ces applications nécessitent du temps de développement : modélisation de la base de données, création des formulaires, gestion des droits d’accès, déploiement. Aujourd’hui, un modèle d’IA avancé peut générer l’ensemble de cette structure en quelques minutes à partir d’une description fonctionnelle. La complexité technique est automatisée.

Un CRM, ou Customer Relationship Management, est un logiciel de gestion de la relation client. Il permet de suivre les prospects, les ventes, les interactions, les relances, les factures ou encore le service après-vente. Sur le segment small business, beaucoup de CRM sont relativement simples : fiches clients, historique des échanges, pipeline commercial, tableaux de suivi.

Or ces fonctionnalités reposent précisément sur des logiques CRUD enrichies : création de fiches, mise à jour des statuts, consultation des données, suppression ou archivage. Lorsque l’IA permet de générer automatiquement ces briques de base, la différenciation fonctionnelle de nombreux CRM légers s’amenuise.

Autrement dit, une grande partie de l’activité des agences et des éditeurs spécialisés sur le small business consiste à produire des systèmes structurés autour de bases de données et d’interfaces standards. Si ces briques deviennent générables à la demande, leur coût marginal tend vers zéro. La pression ne porte plus seulement sur le prix, mais sur la justification même de la récurrence tarifaire.

Les éditeurs de logiciels spécialisés sur ce même segment small business sont également exposés. Beaucoup vendent des solutions verticalisées (gestion pour cabinets médicaux, gestion pour restaurants, gestion pour artisans) avec un pricing récurrent par utilisateur. Si une IA peut recréer 70 à 80 % de ces fonctionnalités en interne, à moindre coût et avec une personnalisation plus fine, la pression concurrentielle devient immédiate. La barrière d’entrée logicielle s’effondre.

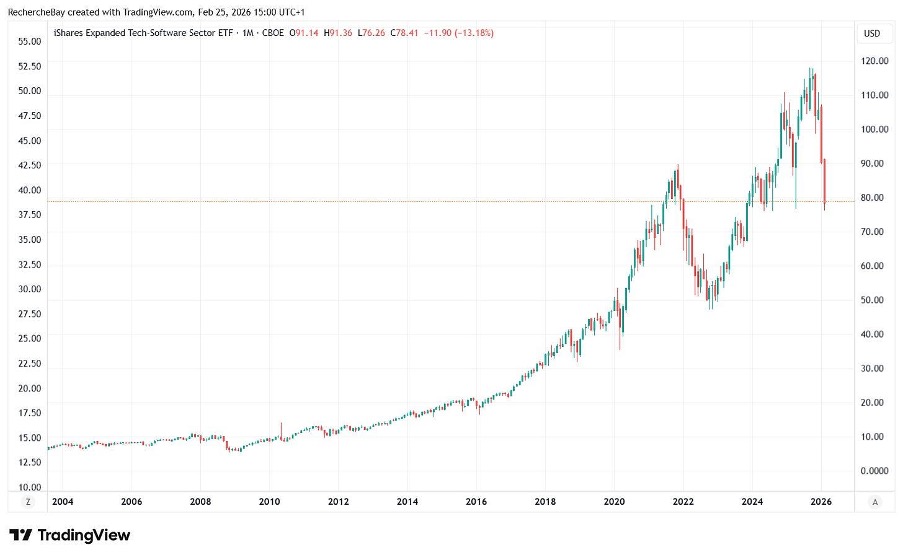

Il n’est donc guère surprenant, dans ces conditions, de voir l’ETF dédié au secteur logiciel subir une correction marquée au cours des deux derniers mois, alors même que les niveaux de valorisation demeurent encore élevés en termes absolus :

Pour les grands acteurs du SaaS, le risque est différent mais réel. Il ne s’agit pas d’une disparition pure et simple, mais d’une fragilisation du modèle de licence per seat. Ce modèle suppose que chaque knowledge worker a besoin d’un accès individuel, permanent, facturé mensuellement. Or si l’IA orchestre les workflows, génère les rapports, automatise les analyses et réduit le nombre d’interactions humaines nécessaires, le nombre de licences actives peut mécaniquement diminuer.

L’IA ne supprime pas l’infrastructure. Elle réduit potentiellement le nombre d’utilisateurs humains nécessaires pour produire le même résultat. Dans un monde où un agent IA traite les données, génère les exports et prépare les audits, l’entreprise peut n’avoir besoin que d’un nombre limité de licences pour validation et supervision finale.

Autrement dit, la menace ne porte pas seulement sur le produit, mais sur l’unité économique du logiciel. Le seat n’est plus forcément l’unité pertinente de monétisation lorsque l’intelligence est automatisée.

C’est cette mutation — rareté du code en voie de disparition et automatisation croissante des tâches cognitives — qui met sous tension le modèle SaaS tel qu’il a été conçu au cours des deux dernières décennies.

Cette pression sur le modèle per seat ne reste pas cantonnée à la sphère technologique. Elle remonte immédiatement toute la chaîne du financement.

Depuis plus d’une décennie, le SaaS a été l’actif idéal pour le private equity et le crédit privé. Revenus récurrents, forte visibilité, marges élevées, faible intensité capitalistique, croissance prévisible : tout cela permettait d’appliquer des multiples élevés et, surtout, de supporter des structures de dette importantes. Le modèle d’abonnement par utilisateur offrait une illusion de stabilité quasi obligataire. On valorisait des flux lointains comme s’ils étaient presque garantis.

Si l’IA fragilise cette stabilité — non pas nécessairement en détruisant les revenus, mais en élargissant la distribution des scénarios — alors le risque perçu change radicalement.

La compression potentielle du modèle per seat implique plusieurs conséquences. D’abord, un risque sur la croissance organique : si les entreprises réduisent le nombre de licences nécessaires grâce à l’automatisation, le net revenue retention baisse. Ensuite, un risque sur les marges : face à des alternatives internes générées par IA, les éditeurs doivent ajuster leurs prix ou enrichir leurs offres. Enfin, un risque sur la visibilité des flux futurs, ce qui est le cœur même de la valorisation SaaS.

Or une large part des acquisitions de logiciels au cours des dix dernières années a été financée via des LBO fortement levés.

Un LBO (Leveraged Buyout) est une opération de rachat d’entreprise financée en grande partie par de la dette. Concrètement, un fonds de private equity acquiert une société en n’apportant qu’une fraction du capital en fonds propres, le reste étant financé par des emprunts contractés au niveau de la cible elle-même. La dette est ensuite remboursée grâce aux flux de trésorerie générés par l’entreprise acquise.

Le secteur du logiciel, et en particulier le SaaS, s’est prêté idéalement à ce type de montage financier. Pourquoi ? Parce que les revenus récurrents par abonnement offrent une forte visibilité sur les flux futurs. Cette prévisibilité permet d’anticiper la capacité de remboursement et donc de supporter un levier élevé — c’est-à-dire un ratio dette/EBITDA important.

Dans un environnement de taux bas et de liquidité abondante, de nombreux éditeurs de logiciels ont ainsi été rachetés à des multiples élevés, souvent supérieurs à 15 ou 20 fois l’EBITDA, avec une part significative de dette. Tant que la croissance restait solide et que les marges demeuraient élevées, le montage fonctionnait : la hausse des revenus permettait de réduire progressivement le levier et de préparer une revente à un multiple attractif.

Les fonds de private equity ont surpondéré le SaaS, précisément parce que la récurrence des abonnements permettait de soutenir un levier élevé. Les véhicules de crédit privé ont, de leur côté, massivement financé ces opérations, attirés par des spreads attractifs sur des business jugés défensifs.

Si la perception de stabilité de ces flux se fissure, le problème ne concerne plus uniquement les éditeurs côtés. Il concerne l’ensemble des bilans qui ont financé leur expansion.

Une compression des multiples SaaS réduit mécaniquement la valeur des collatéraux. Une baisse de croissance ou de marges fragilise les covenants. Une augmentation de la volatilité des flux accroît le risque de refinancement. Ce qui était perçu comme un actif “long duration stable” devient un actif “long duration incertain”. Dans ce contexte, la réaction des marchés peut sembler incohérente à court terme — vendre les valeurs logicielles tout en maintenant les financières ou les véhicules de private equity — mais la logique économique, elle, demeure implacable. Si la stabilité des flux de trésorerie sous-jacents est remise en question, c’est l’ensemble de la chaîne de financement qui doit être réévalué.

Le risque ne s’arrête pas aux éditeurs de logiciels. Il se propage, en bout de chaîne, vers les acteurs du crédit et du financement. Le secteur bancaire n’est pas immunisé : il est exposé indirectement à travers le financement des opérations de LBO, du crédit privé et des véhicules d’investissement fortement positionnés sur le SaaS. Si la qualité perçue des cash-flows se détériore, le risque de crédit augmente mécaniquement.

Le marché commence d’ailleurs à intégrer cette possibilité. L’ETF Financial Select Sector SPDR Fund (XLF) affiche déjà une sous-performance relative par rapport aux grands indices, signe que la contamination potentielle du risque vers les financières est progressivement prise en compte.

Cette première commoditisation que nous avons décrite ne menace donc pas seulement les modèles d’affaires des éditeurs. Elle remet en question l’architecture financière qui s’est construite autour de la stabilité supposée du SaaS.

C’est là que l’enjeu devient systémique. Lorsque la technologie modifie la visibilité des flux futurs, elle modifie aussi la perception du risque de crédit. Et lorsque le crédit se reprice, ce n’est plus un simple ajustement sectoriel, mais un changement de régime.

La deuxième commoditisation est plus sournoise. Elle ne vise plus seulement le logiciel applicatif ; elle s’attaque au cœur même du modèle économique de l’IA. Elle menace les outils IA dans leur core business en modifiant leur futur modèle de monétisation.

Jusqu’ici, la rente des acteurs comme OpenAI ou Anthropic reposait sur une hypothèse implicite : les modèles frontier seraient rares, coûteux à entraîner et difficilement réplicables. Cette rareté justifiait un pricing API élevé, des abonnements premium et, surtout, un CapEx massif consacré aux clusters d’entraînement.

Or cette rareté s’érode plus vite que prévu.

L’open-source joue ici un rôle déterminant. Des modèles comme Meta (avec Llama) ont ouvert la voie à une diffusion rapide des architectures avancées. Des frameworks tels qu’Ollama, LM Studio ou les formats quantisés GGUF permettent désormais de faire tourner localement des modèles performants sur du hardware accessible. La quantization, la distillation et l’optimisation inference réduisent drastiquement le coût de déploiement.

Parallèlement, plusieurs acteurs chinois — tels que DeepSeek ou MiniMax — ont accéléré la convergence en s’appuyant sur des techniques de distillation et d’itération rapide. La logique est simple : observer le comportement des modèles frontier, entraîner des modèles plus compacts capables d’en reproduire une large partie des performances, puis les distribuer à coût marginal faible. La barrière à l’entrée ne disparaît pas, mais elle se réduit.

Dans ce contexte, la performance absolue n’est plus la seule variable. Pour une PME, un modèle qui couvre 70 à 80 % des usages — génération de rapports, analyse de documents, automatisation de tâches administratives — est souvent suffisant. Si ce modèle peut être exécuté localement, avec les données internes, sans dépendre d’une API cloud facturée au token, l’équation économique change radicalement.

Nous entrons alors dans un monde hybride : l’IA locale traite les flux internes, les audits, les documents sensibles ; seuls les cas complexes, multimodaux ou nécessitant une puissance exceptionnelle remontent vers le cloud. La dépendance aux API centralisées diminue. Le pricing power des fournisseurs frontier se fragilise.

Et c’est ici que la seconde commoditisation devient stratégique. Si la majorité des usages quotidiens bascule vers des modèles open-source ou localisés, la rente ne se situe plus dans la simple exécution du modèle. Elle se déplace vers l’orchestration, la donnée propriétaire et l’infrastructure.

La compression ne toucherait plus seulement les éditeurs SaaS. Elle concernerait également la justification du CapEx massif consacré à l’entraînement des modèles frontier. Si l’écart de performance entre modèle frontier et modèle optimisé localement n’est perçu comme critique que pour une minorité d’usages, alors l’élasticité prix des API augmente, et la course à l’armement des data centers devient plus difficile à rentabiliser.

Autrement dit, la première commoditisation fragilise la couche applicative. La seconde remet en question la rareté même de l’intelligence artificielle comme service.

C’est cette double pression qui élargit la distribution des scénarios et qui rend la valorisation actuelle du secteur technologique de plus en plus sensible à la moindre inflexion.

Cette double pression élargit la distribution des scénarios possibles. Les flux futurs des sociétés technologiques deviennent moins lisibles. Or les valorisations du software et de l’IA reposent sur des cash-flows lointains, sur une duration extrêmement longue. Lorsque l’incertitude augmente, les multiples se compressent mécaniquement.

C’est ici que la rotation sectorielle prend tout son sens.

Le marché ne fuit pas uniquement le risque. Il fuit l’instabilité de la duration. Les actifs longue duration — software, enterprise tech, IA applicative — deviennent plus fragiles face à une distribution d’issues plus large. En parallèle, les actifs à cash-flows tangibles et proches dans le temps sont revalorisés.

Le run sur les matières premières, les métaux et les minières doit être lu dans ce contexte.

Les sociétés technologiques sont celles qui vont porter le CapEx massif du cycle IA : data centers, GPU, réseaux électriques, refroidissement, infrastructures numériques. Les minières, elles, sont les vendeurs de pelles de cette ruée. Cuivre, uranium, nickel, terres rares, argent industriel : sans ces intrants physiques, aucune infrastructure IA n’existe. La dématérialisation numérique repose sur une matérialité extrême.

Contrairement aux sociétés technologiques, les minières ne sont pas valorisées sur des promesses de cash-flows perpétuels à dix ou quinze ans. Elles génèrent des flux liés à des actifs physiques, à des réserves mesurables, à des cycles d’offre et de demande tangibles. Dans un monde où la visibilité sur la rente logicielle se brouille, la visibilité sur la tonne extraite et vendue retrouve une prime.

Cette dynamique explique également la résilience relative des secteurs énergie, matériaux et industriels. La duration y est plus courte, les cash-flows plus immédiats, la dépendance à une distribution technologique incertaine plus faible.

Et au sommet de cette hiérarchie du tangible se trouve l’or.

Dans un environnement où l’issue du cycle IA demeure incertaine — explosion permanente du compute ou hybridation locale limitant la centralisation — l’or joue son rôle classique de refuge face à l’inconnu systémique. L’IA élargit les « tails » de distribution économique. Elle modifie les modèles d’affaires, les besoins en capital, potentiellement même la structure de l’emploi qualifié. Face à cette incertitude croissante, les investisseurs cherchent un actif qui ne dépend ni d’un modèle SaaS, ni d’un CapEx hyperscale, ni d’une adoption technologique spécifique.

L’or physique ne dépend d’aucun scénario d’innovation. Il dépend de la confiance.

Nous sommes donc face à une configuration complexe. Le cycle IA peut justifier un CapEx massif si l’usage devient permanent et omniprésent. Il peut au contraire engendrer une compression si la commoditisation locale réduit la rente des plateformes. Entre ces deux extrêmes, les investisseurs arbitrent vers ce qui est rare, tangible et moins sensible à la duration longue.

La ruée vers l’IA nourrit la demande en métaux stratégiques. L’incertitude sur sa monétisation nourrit la demande d’or.

Le paradoxe est saisissant : plus l’intelligence devient artificielle, plus la valeur refuge redevient profondément matérielle.

La reproduction, intégrale ou partielle, est autorisée à condition qu’elle contienne tous les liens hypertextes et un lien vers la source originale.

Les informations contenues dans cet article ont un caractère purement informatif et ne constituent en aucun cas un conseil d’investissement, ni une recommandation d’achat ou de vente.