Le marché continue de célébrer l’IA comme une révolution technologique quasi illimitée. Pourtant, derrière les records boursiers des hyperscalers américains se cache peut-être l’un des plus grands cycles de dépenses d’infrastructure de l’histoire moderne — avec des risques considérables sur les rendements futurs du capital investi.

Le débat n’est plus simplement technologique. Il devient désormais énergétique, industriel, financier et même macroéconomique.

Pendant des années, les investisseurs ont valorisé les géants technologiques comme des plateformes software ultra-scalables : coûts marginaux faibles, marges élevées, croissance quasi infinie. Mais l’IA générative casse progressivement ce modèle. Les grands modèles de langage nécessitent des quantités gigantesques de GPU, d’électricité, de refroidissement, de data centers et de réseaux. Plus les modèles deviennent sophistiqués, plus la consommation de compute explose.

Le grand pari haussier (bull case) sur lequel repose aujourd’hui une partie de la valorisation du secteur de l’intelligence artificielle n’est plus simplement l’idée que davantage de personnes utiliseront des chatbots comme ChatGPT. Le véritable scénario optimiste défendu par Goldman Sachs dans son étude publiée cette semaine est beaucoup plus ambitieux : celui des agents IA autonomes.

Pour comprendre la différence, il faut d’abord imaginer ce qu’est un chatbot classique aujourd’hui. Lorsqu’un utilisateur pose une question à ChatGPT, le système génère une réponse, puis la conversation s’arrête jusqu’à la prochaine demande. L’IA agit donc comme un assistant ponctuel : elle répond à une question, rédige un texte, résume un document ou traduit une phrase.

Un agent IA, en revanche, fonctionnerait de manière beaucoup plus autonome et continue. Au lieu de simplement répondre à une question unique, il pourrait accomplir des tâches entières de manière indépendante. Par exemple :

- organiser un voyage complet ;

- comparer des centaines d’options ;

- réserver des billets ;

- surveiller des prix en temps réel ;

- rédiger et envoyer des emails ;

- analyser des documents ;

- corriger ses propres erreurs ;

- vérifier plusieurs sources ;

- utiliser des logiciels externes ;

- ou même superviser d’autres agents spécialisés.

En pratique, cela signifie qu’un agent IA ne produit plus seulement une réponse rapide, mais qu’il “réfléchit” beaucoup plus longtemps et effectue énormément d’opérations internes invisibles pour l’utilisateur.

Et c’est là que le sujet devient extrêmement important économiquement.

Chaque opération réalisée par une IA consomme des tokens. Un token est simplement une petite unité de texte utilisée par les modèles pour traiter l’information. Plus une IA lit, écrit, vérifie, raisonne ou maintient une conversation longue, plus elle consomme de tokens — et donc de puissance informatique.

Un chatbot classique utilise relativement peu de ressources : une question, une réponse.

Mais un agent autonome peut :

- relire plusieurs fois les mêmes informations ;

- tester plusieurs raisonnements ;

- effectuer des vérifications ;

- lancer des recherches ;

- utiliser des outils externes ;

- maintenir des contextes gigantesques ;

- fonctionner en arrière-plan en permanence.

Résultat : la consommation de puissance informatique explose.

C’est précisément ce que Goldman Sachs considère comme le cœur du scénario haussier pour l’IA. Le marché ne parie plus seulement sur “plus d’utilisateurs”, mais surtout sur “beaucoup plus de calculs par utilisateur”.

Autrement dit, même si le coût unitaire des modèles baisse, la quantité totale de calculs nécessaires pourrait augmenter encore beaucoup plus vite. Goldman estime ainsi que les besoins mondiaux en capacité informatique pour l’IA pourraient représenter plus de 24 fois la capacité actuelle d’ici 2030.

Cela change complètement la nature économique du secteur.

Jusqu’à présent, l’IA ressemblait surtout à une activité extrêmement coûteuse :

- construction de data centers géants ;

- achat de milliers de GPU ;

- consommation électrique gigantesque ;

- investissements massifs dans les infrastructures.

Le problème était que les revenus générés semblaient encore parfois insuffisants face à ces dépenses colossales.

Mais si les agents IA deviennent omniprésents et consomment énormément de puissance informatique en permanence, alors ces infrastructures pourraient être beaucoup mieux utilisées. Les centres de données fonctionneraient à pleine capacité, les GPU seraient amortis plus efficacement et les marges pourraient commencer à s’améliorer fortement.

C’est ce que Goldman appelle le “point d’inflexion” des marges : le moment où l’IA cesse d’être principalement un centre de coûts pour devenir potentiellement une activité très rentable.

Ce scénario optimiste se heurte immédiatement à une limite très concrète : le monde physique.

Car faire fonctionner des agents IA massivement nécessite :

- des quantités gigantesques d’électricité ;

- des milliers de GPU supplémentaires ;

- de nouveaux data centers ;

- des systèmes de refroidissement ;

- des réseaux électriques renforcés.

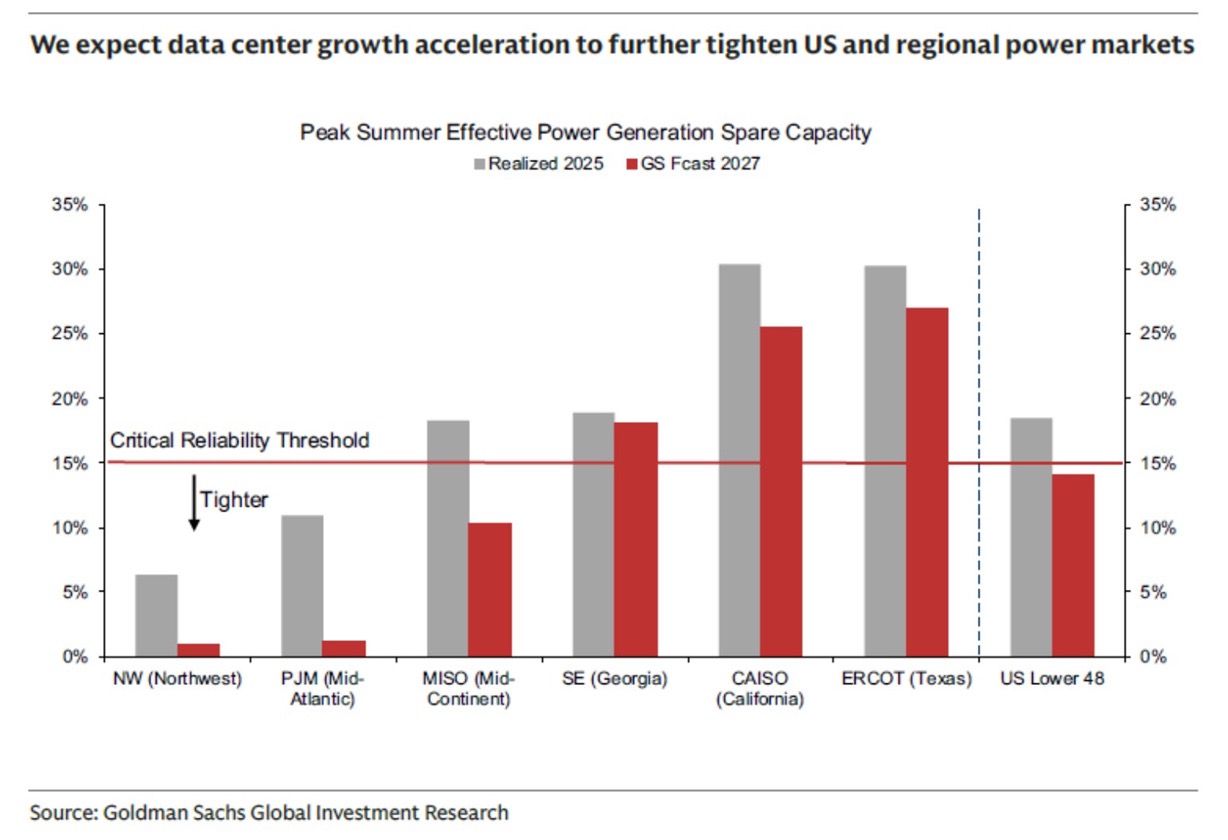

Et c’est là que commencent les inquiétudes. Les réseaux électriques américains montrent déjà des signes de saturation dans certaines régions :

Les délais de raccordement explosent, les transformateurs manquent, les communautés locales s’opposent parfois aux projets de data centers, et les coûts énergétiques augmentent.

Autrement dit, le scénario où l’IA devient réellement très rentable est aussi celui où elle risque de pousser les infrastructures énergétiques mondiales à leurs limites physiques.

C’est tout le paradoxe fondamental du cycle IA : le seul scénario où les investissements massifs deviennent réellement rentables est aussi celui qui risque de pousser le système physique vers ses limites.

Les projections actuelles supposent des dizaines de gigawatts de nouvelles capacités électriques, des milliers de GPU supplémentaires et une accélération massive des constructions de data centers. Or les goulets d’étranglement commencent déjà à apparaître partout : transformateurs indisponibles, files d’attente de raccordement, pénuries de turbines, manque de cuivre, contraintes hydriques, opposition locale, saturation des réseaux électriques et délais administratifs.

Goldman Sachs reconnaît d’ailleurs explicitement dans ses travaux que plus les délais de construction des data centers s’allongent, plus la probabilité que ces projets deviennent réellement opérationnels diminue. Autrement dit, une partie des revenus futurs actuellement intégrés dans les valorisations boursières des géants technologiques repose peut-être sur des projets qui ne sont pas encore réellement opérationnels — et qui, dans certains cas, pourraient même ne jamais voir le jour dans les délais annoncés.

C’est un point extrêmement important, mais souvent mal compris par les investisseurs non spécialistes.

Aujourd’hui, les hyperscalers comme Microsoft, Amazon, Google ou Meta communiquent beaucoup sur leur backlog, c’est-à-dire les engagements de revenus futurs déjà signés avec des clients ou anticipés via des projets d’infrastructure.

En théorie, cela rassure les marchés : plus le backlog augmente, plus les investisseurs considèrent que la croissance future est “visible” et relativement sécurisée.

Le problème est qu’un backlog ne signifie pas forcément qu’une capacité réelle existe déjà.

Dans le cas de l’IA, une grande partie de ces revenus futurs dépend encore d’infrastructures qui doivent :

- être construites ;

- obtenir leurs autorisations ;

- être raccordées au réseau électrique ;

- recevoir suffisamment de GPU ;

- disposer d’eau et de systèmes de refroidissement ;

- et fonctionner réellement à pleine capacité.

Or aujourd’hui, beaucoup de projets de data centers annoncés sont encore à l’état :

- de terrain réservé ;

- de projet administratif ;

- de permis en attente ;

- ou de capacité électrique non garantie.

Autrement dit, le marché valorise parfois des revenus futurs comme s’ils étaient déjà pratiquement acquis, alors que les infrastructures physiques nécessaires n’existent pas encore.

Prenons un exemple simple.

Imaginez qu’une entreprise annonce la construction d’une immense usine capable de produire des milliards d’euros de chiffre d’affaires dans trois ans. Les investisseurs pourraient immédiatement commencer à valoriser cette future production.

Mais si, entre-temps :

- les permis environnementaux sont retardés ;

- les coûts explosent ;

- l’électricité manque ;

- les équipements ne sont pas livrés ;

- ou les financements deviennent plus difficiles,

alors cette usine pourrait être :

- retardée ;

- réduite ;

- ou parfois abandonnée.

C’est exactement le risque que Goldman Sachs commence à souligner pour les data centers IA.

Le marché agit aujourd’hui comme si “tout ce qui est annoncé sera livré”.

Mais l’histoire des grandes infrastructures montre que ce n’est presque jamais le cas.

Plus un projet est éloigné dans le temps, plus les risques augmentent :

- inflation des coûts ;

- contraintes énergétiques ;

- opposition politique ;

- difficultés de financement ;

- changements technologiques ;

- ou baisse de rentabilité.

Et dans le cas de l’IA, ces risques sont particulièrement élevés parce que les besoins physiques sont gigantesques.

Un grand data center IA moderne ne nécessite pas seulement des ordinateurs. Il faut aussi :

- des lignes haute tension ;

- des transformateurs ;

- des turbines ;

- des systèmes de refroidissement ;

- parfois autant d’électricité qu’une ville entière.

Le problème est que les réseaux électriques occidentaux n’ont pas été conçus pour absorber une explosion aussi rapide de la demande.

C’est pour cela que Goldman Sachs explique que plus l’horizon de livraison d’un data center est lointain, plus la probabilité réelle qu’il soit activé diminue.

En d’autres termes, une partie du pipeline actuellement présenté aux investisseurs pourrait être davantage une ambition théorique qu’une capacité garantie.

Et cela change énormément la lecture des valorisations actuelles.

Car les marchés valorisent aujourd’hui :

- les revenus futurs ;

- les marges attendues ;

- les besoins en GPU ;

- et même les commandes énergétiques,

comme si toute cette infrastructure allait fonctionner parfaitement et dans les délais.

Mais si :

- les constructions prennent du retard ;

- les raccordements électriques deviennent impossibles ;

- les coûts énergétiques explosent ;

- ou les technologies évoluent plus vite que prévu,

alors certains projets pourraient produire beaucoup moins de revenus que ce que le marché anticipe actuellement.

Le risque n’est donc pas forcément que l’IA “échoue”.

Le vrai risque pourrait être que les marchés aient valorisé aujourd’hui une infrastructure future qui n’existe pas encore réellement dans le monde physique.

Cette problématique devient encore plus inquiétante lorsque l’on observe la structure même du financement du boom IA. Les hyperscalers eux-mêmes semblent hésiter à porter seuls ces investissements gigantesques sur leurs bilans. Les structures de private credit et les SPVs se multiplient afin d’externaliser une partie du risque financier. Meta a ainsi récemment structuré plusieurs véhicules de financement de data centers avec Blue Owl, transformant progressivement l’infrastructure IA en véritable produit de crédit structuré.

Le marché obligataire investment grade américain devient lui aussi de plus en plus dépendant du build-out IA. Les hyperscalers et les structures de financement de data centers représentent désormais une part massive des nouvelles émissions obligataires pondérées par duration. Le problème est évident : les créanciers financent un secteur extrêmement capitalistique avec un upside plafonné, alors que les actionnaires capturent l’essentiel des gains potentiels si l’IA réussit.

Mais le risque le plus sous-estimé aujourd’hui pourrait paradoxalement venir… des progrès technologiques eux-mêmes.

De nouvelles architectures d’IA cherchent à rendre les modèles beaucoup plus efficaces en évitant des calculs inutiles.

Aujourd’hui, les modèles comme ChatGPT analysent énormément de relations entre les mots d’un texte, même lorsque beaucoup de ces liens ne sont pas vraiment utiles. Cela demande une puissance informatique gigantesque.

Les systèmes dits de sparse attention essaient au contraire de ne traiter que les informations réellement importantes, un peu comme un humain qui se concentre uniquement sur les passages clés d’un livre.

Si cette technologie fonctionne à grande échelle, elle pourrait réduire fortement les besoins en GPU, en électricité et en data centers nécessaires pour l’IA.

Si ces approches fonctionnent à grande échelle, elles pourraient casser une partie de la logique actuelle de pénurie permanente de GPU et d’électricité.

Autrement dit, le marché est peut-être en train de construire une quantité gigantesque d’infrastructures sur l’hypothèse que les besoins en compute continueront d’exploser de manière linéaire. Or, l’histoire technologique montre souvent le contraire : les gains d’efficacité logiciels finissent par réduire brutalement les besoins matériels anticipés.

Le parallèle avec les télécoms à la fin des années 1990 devient de plus en plus frappant. La révolution internet était réelle. La demande était réelle. Mais les projections de rentabilité et les investissements infrastructurels se sont révélés largement excessifs. Le résultat fut une destruction massive de capital malgré le succès technologique de long terme.

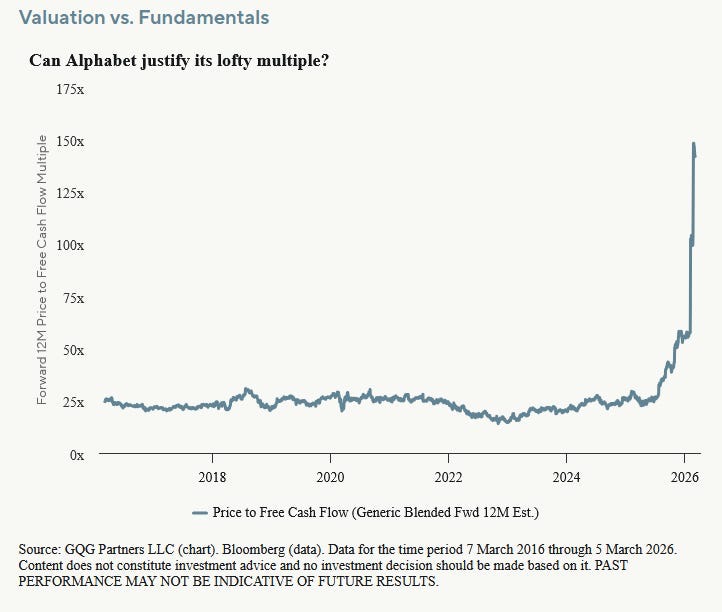

L’exemple d’Alphabet illustre parfaitement ce risque croissant de déconnexion entre valorisation et réalité économique.

Alphabet se traite désormais autour de 133 fois son free cash flow, contre environ 20 fois avant le COVID.

Pourtant, son free cash flow n’a pratiquement pas progressé depuis 2021. Plusieurs grands investisseurs institutionnels commencent d’ailleurs à s’inquiéter ouvertement de cette dynamique.

Premier problème : l’IA menace directement le moteur économique historique de Google. Une part croissante des recherches se termine désormais sans clic publicitaire. Or, sans clic, il n’y a pas d’impression publicitaire, donc pas de revenus associés.

Deuxième problème : l’explosion du capex. Google prévoit entre 175 et 185 milliards $ de dépenses d’investissement en 2026, alors même que Google Cloud n’a généré qu’environ 59 milliards $ de revenus en 2025. L’économie du système commence à ressembler davantage à celle d’une utility énergivore qu’à celle d’un éditeur software à forte marge.

Troisième problème : la cyclicité publicitaire. Lorsque l’économie ralentit, les budgets publicitaires sont historiquement parmi les premiers sacrifiés. En 2022, Alphabet avait déjà perdu près de 40 % dans un contexte de ralentissement du marché publicitaire.

Alphabet reste évidemment une entreprise exceptionnelle. Mais à ces niveaux de valorisation, le marché ne laisse quasiment aucune marge d’erreur alors même que les risques augmentent simultanément : explosion du capex, pression sur les marges, dépendance énergétique, concurrence IA, besoins de refinancement et incertitude sur les véritables rendements futurs du capital investi.

Dans ce contexte, l’or physique retrouve progressivement son rôle traditionnel de valeur refuge face aux excès de valorisation, aux cycles de dette et aux grands déséquilibres financiers. Si le boom IA continue de pousser le système vers davantage de levier, de dépendance énergétique et de fragilité du crédit, les métaux précieux pourraient redevenir l’un des rares actifs capables de protéger les investisseurs face à un éventuel retournement du cycle technologique et du marché du crédit.

La reproduction, intégrale ou partielle, est autorisée à condition qu’elle contienne tous les liens hypertextes et un lien vers la source originale.

Les informations contenues dans cet article ont un caractère purement informatif et ne constituent en aucun cas un conseil d’investissement, ni une recommandation d’achat ou de vente.